RAWデータの構造を説明する前に、実際に光をデータに変える装置、イメージセンサーについて簡単に説明しておく必要があります。

それは、イメージセンサーは光の強さを感知できますが、その光が何色かの判別ができない、という事です。

基本的に色というのは、光の三原色であるRGBそれぞれのバランスで構成されていますが、イメージセンサーはRGBのバランスは理解できず、明るさのみが解るのです。

イメージセンサが明るさしか理解できないとしたら、一体どのようにして色を作るのでしょうか?

いくら優秀な頭脳をもってしても、色の情報のないデータから正しい色を再現することは不可能です。

そこで仮に、1つの画素にR(もしくはGかB)の光だけを当てたらどうなるでしょうか?

そうです、その画素が感じた光の強さをそのままRの値として用いることができるでしょう。

同様に、別の画素を用いてGやBの光の強さも、それぞれ測ることができれば、RGBがすべて揃い、色を表現できるようになるわけです。

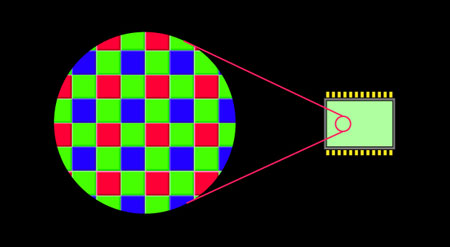

実際のイメージセンサーの各画素には、表面にセロファンのようなカラーフィルタが取り付けられていて、画素ごとにRGBを感じ取れるようになっています。

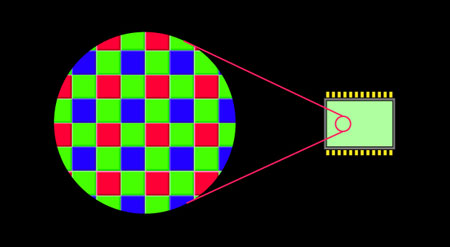

現在普及しているイメージセンサーは、上図のような配列をしている物がほとんどで、このような配列をBayer(ベイヤー)配列と呼んでいます。

ご覧のように、画素一つにつき一色しか取れないため、このRGBが並んだBayer配列から、色を正確に再現し、人間の目に見える画像にしなくてはなりません。

その処理こそが「現像」処理であり、SILKYPIXなのです。